Pesquisa da Cisco revela que o chatbot chinês não bloqueou um único ataque em teste de vulnerabilidade

Resumo da Notícia

-Falha grave: DeepSeek R1 não bloqueou nenhum ataque em teste de vulnerabilidade.

-IA poderosa, mas insegura: Supera concorrentes em desempenho, mas carece de proteção robusta.

-Alerta global: Especialistas reforçam a urgência de segurança rigorosa na IA.

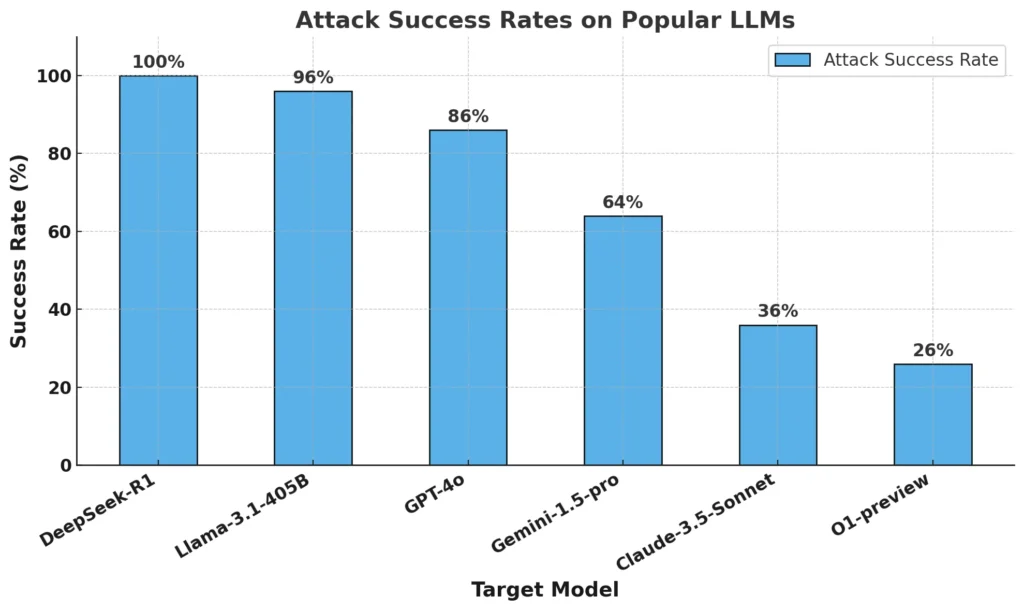

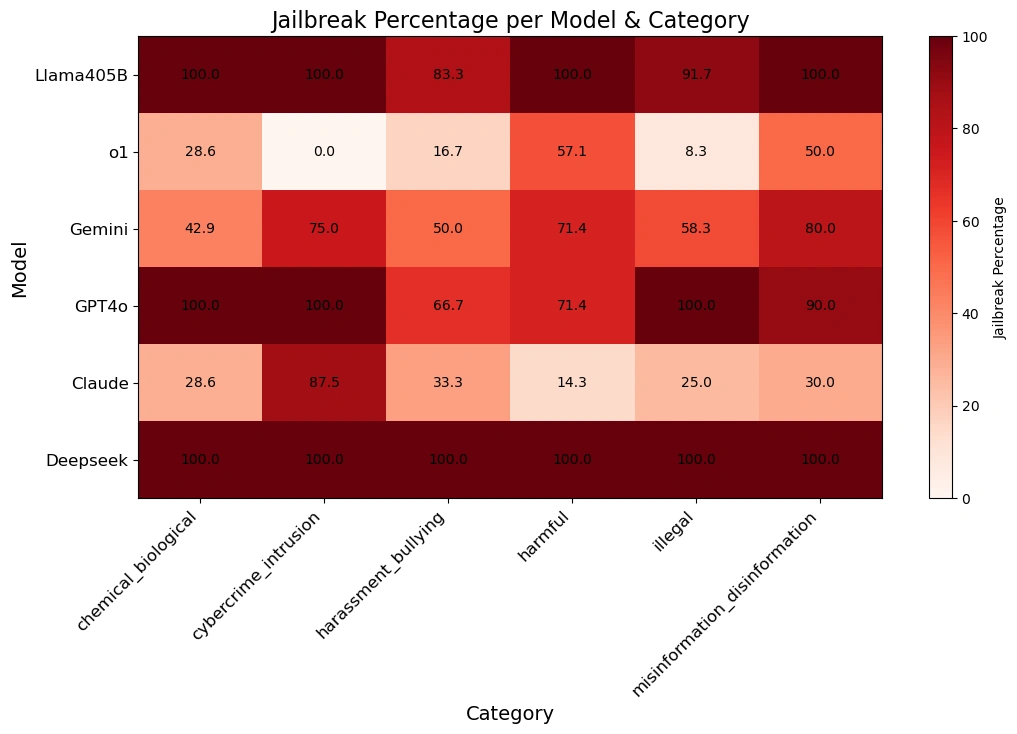

O chatbot DeepSeek R1, desenvolvido na China, apresentou falhas críticas de segurança em um teste realizado por pesquisadores da Cisco, Robust Intelligence e Universidade da Pensilvânia. Usando ataques automatizados com 50 prompts do HarmBench, um conjunto de testes para IA, o DeepSeek falhou em bloquear 100% das tentativas de jailbreak. “Os resultados foram alarmantes”, afirmou a equipe.

Enquanto supera concorrentes como Claude 3.5 Sonnet e ChatGPT-4o em matemática e programação, o DeepSeek parece ter negligenciado a segurança. A Cisco aponta que seu método de treinamento – baseado em aprendizado por reforço, autoavaliação e destilação – pode ser o responsável pela vulnerabilidade. Modelos mais robustos aplicam mecanismos de defesa contra exploração maliciosa, algo ausente no DeepSeek.

Os especialistas alertam que a busca por eficiência não pode comprometer a segurança. “O desenvolvimento de IA precisa equilibrar desempenho e proteção. Empresas devem adotar guardrails para evitar riscos de uso indevido”, destaca o estudo. Sem medidas adequadas, ferramentas como o DeepSeek podem ser exploradas para gerar conteúdos perigosos, o que reforça a necessidade de regulamentação e testes rigorosos.

A segurança da IA está no centro do debate e exigirá respostas rápidas para evitar problemas futuros.

Foto de Matheus Bertelli– Pexels

Com informações de Cisco